Hy-MT1.5-1.8B-1.25bit是什么

Hy-MT1.5-1.8B-1.25bit 是腾讯混元团队推出的极致量化压缩版手机端离线翻译大模型。模型基于混元翻译大模型 Hy-MT1.5-1.8B(18亿参数)打造,通过创新的 Sherry 稀疏三值量化技术 将模型压缩至仅 440MB,支持 33种语言、5种方言/民汉 及 1056个翻译方向,无需联网可在手机本地运行,翻译质量超越谷歌翻译等主流商业系统。

Hy-MT1.5-1.8B-1.25bit的主要功能

33种语言离线互译:覆盖中英、法日、阿拉伯语、俄语等主流语言,以及藏语、蒙古语等少数民族语言,共1056个翻译方向。

手机端本地运行:下载模型后即可完全离线翻译,无需网络连接,不消耗流量。

后台取词翻译:配套Demo支持”后台取词模式”,在浏览网页、查看邮件时可随时调用翻译。

文本实时翻译:输入或粘贴文本后快速生成翻译结果,支持复制输出。

多语言方向切换:支持任意语言对之间的双向翻译切换。

Hy-MT1.5-1.8B-1.25bit的技术原理

基础模型:基于腾讯混元翻译大模型 Hy-MT1.5-1.8B(1.8B参数),该模型通过”通用预训练→MT定向预训练→监督微调→在线蒸馏→强化学习”多阶段训练框架打造。

Sherry 稀疏三值量化(1.25-bit):采用细粒度稀疏策略,每4个参数中3个用1-bit存储(取值为-1或1),1个置为0,平均每个参数仅需 1.25 bit。

STQ 专用内核:腾讯专为手机CPU设计的稀疏三值量化推理内核,完美适配 SIMD 指令集,实现高效解码。

量化感知训练(QAT):通过训练中的分布对齐与偏移优化,缓解超低比特量化带来的精度损失。

GRPO 强化学习:采用Group Relative Policy Optimization算法,结合多维度评分标准(准确性、流畅度、一致性、文化适配性、可读性)优化翻译质量。

如何使用Hy-MT1.5-1.8B-1.25bit

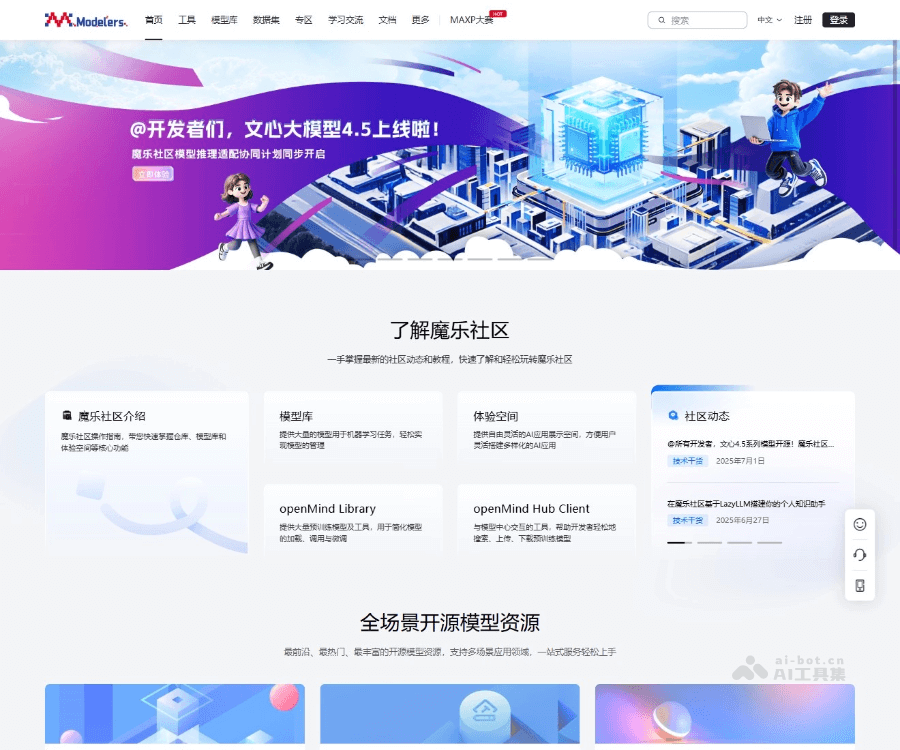

下载安装:从魔搭社区 https://modelscope.cn/models/AngelSlim/Hy-MT1.5-1.8B-1.25bit-GGUF/resolve/master/Hy-MT-demo.apk 或 HuggingFace 下载 Demo APK 并安装。

启动加载:首次打开自动加载 440MB 模型,加载完成后即可使用。

文本翻译:输入或粘贴文本,点击 Translate 可离线翻译;点击底部语言栏可切换翻译方向。

后台取词:在其他 App 中长按选中文本,选择”离线翻译”,悬浮窗直接显示结果,无需跳转。

Hy-MT1.5-1.8B-1.25bit的关键信息和使用要求

发布方:腾讯混元团队

模型参数:1.8B

量化精度:1.25-bit(Sherry稀疏三值量化)

模型体积:440MB

支持平台:安卓(Demo版),iOS正式版后续支持

开源协议:模型权重、代码、技术报告全面开源

系统:安卓手机(Demo版暂不支持iOS)

内存:建议8GB及以上(演示设备为骁龙865/888/7+Gen2,8GB/16GB内存)

存储:预留约500MB空间下载模型

网络:首次下载模型需联网,之后可完全离线使用

Hy-MT1.5-1.8B-1.25bit的核心优势

极致轻量化:模型仅 440MB,原始FP16版本为3.3GB,压缩比约 7.5倍,普通手机可常驻后台。

翻译质量高:在Flores-200、WMT25等基准上,1.8B原始模型已超越谷歌翻译、百度翻译、微软翻译等商业API和Tower-Plus-72B、Qwen3-32B等更大开源模型;1.25bit量化版在保持极小体积的同时,质量损失可控。

推理速度快:配合STQ内核,在骁龙888手机上翻译速度比FP16版本快约 8倍(1.9秒 vs 58.2秒)。

全离线零隐私:完全本地处理,无需上传任何数据,无订阅费用,一次下载永久使用。

硬件适配友好:1.25bit方案对SIMD指令集友好,全系安卓机型均可流畅运行。

Hy-MT1.5-1.8B-1.25bit的项目地址

- HuggingFace模型库:https://huggingface.co/AngelSlim/Hy-MT1.5-1.8B-1.25bit

- arXiv技术论文:https://arxiv.org/pdf/2512.24092

Hy-MT1.5-1.8B-1.25bit的同类竞品对比

| 对比维度 | Hy-MT1.5-1.8B-1.25bit | Tower-Plus-72B | 谷歌翻译 (Google Translate API) |

|---|---|---|---|

| 产品定位 | 端侧离线翻译大模型 | 开源翻译专用大模型 | 商业云端翻译服务 |

| 发布方 | 腾讯混元 | Unbabel / 社区 | |

| 模型体积 | 440 MB | 145 GB | 云端部署(无本地体积) |

| 参数量 | 1.8B | 72B | 未公开 |

| 运行方式 | 手机本地离线运行 | 需服务器 / A100 等高性能 GPU | 云端 API 调用 |

| 联网需求 | ❌ 完全不需要 | ✅ 需部署在服务器 | ✅ 必须联网 |

| 支持语言 | 33 种 + 5 种方言/民汉 | 多语言 | 100+ 种语言 |

| Flores-200 (ZH↔XX) | 82.2 | 79.7 | 69.3 |

| Flores-200 (EN↔XX) | 87.4 | 86.2 | 77.0 |

| WMT25 | 57.0 | 41.0 | 38.9 |

| Minority↔Mandarin | 59.1 | 35.4 | 33.4 |

| 推理速度 | 极快(骁龙888仅 1.9 秒) | 慢(72B 大模型推理成本高) | 依赖网络延迟(通常 1–3 秒) |

Hy-MT1.5-1.8B-1.25bit的应用场景

境外出行:无网络环境(偏远地区、飞机、地铁)下的菜单、路牌、对话实时翻译,解决境外信号不稳定痛点。

商务办公:离线处理涉外邮件、合同文档,敏感商业信息完全本地处理,杜绝数据上传风险。

少数民族沟通:支持藏语、蒙古语、维吾尔语等民汉互译,服务边疆地区日常交流与政务办理。

学术研究:本地阅读外文文献、论文,随时取词翻译,保护学术隐私与知识产权。

日常阅读:离线浏览外文网页、社交媒体、电子书,无需流量即可获取高质量译文。