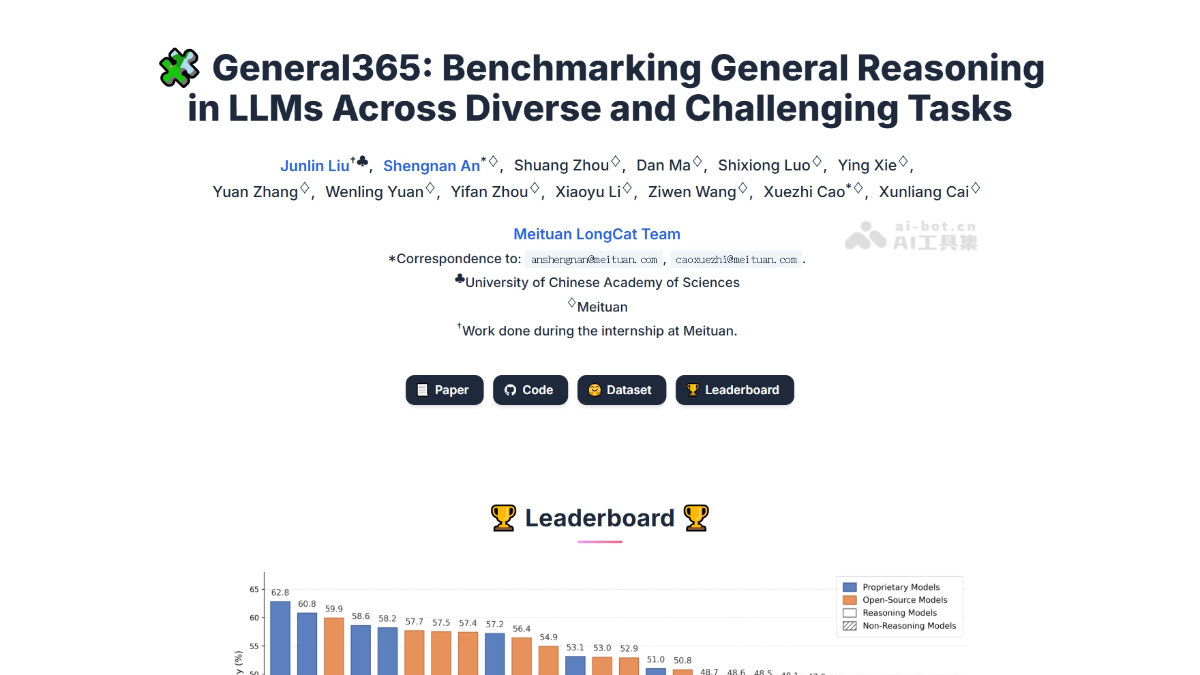

General365是什么

General365 是美团 LongCat 团队开源的通用推理评测基准,包含 365 道原创种子题及 1095 个扩展变体,覆盖八大推理挑战维度。基准将知识范围严格限定在 K-12 水平,解耦大模型的推理能力与专业知识依赖,真实评估模型在日常场景下的通用逻辑推理水平。实测显示,26 款主流大模型中仅 Gemini 3 Pro 达到 62.8% 的准确率,绝大多数模型未过 60% 及格线。

General365的主要功能

高多样性评测:365 道人工原创种子题 + 1095 个变体,覆盖复杂约束、分支枚举、时空推理、递归回溯、语义干扰、隐式信息、最优策略、概率不确定性八大维度。

推理与知识解耦:将背景知识限定在 K-12 范围内,纯粹衡量逻辑推理能力而非知识检索。

混合评分系统:结合规则评分与模型评分(GPT-4.1),人工验证评分准确率达 99.6%。

公开子集与隐藏测试集:已公开 180 道种子题及变体(共 720 题),剩余题目作为隐藏测试集防止数据污染。

多模型横向评测:支持对 OpenAI、Gemini、Anthropic、DeepSeek、Qwen、GLM、Kimi、LongCat 等 26+ 款模型的推理能力进行标准化评估。

General365的技术原理

八大维度拆解通用推理:将通用推理拆解为 8 个核心挑战类型,每道题至少对应其一,近 70% 题目具备两个以上类别标签。

避免模板化与死记硬背:通过 t-SNE 语义分布验证和 Gemini 3 Pro 推理路径相似度评分,确保题目逻辑独立性,防止模型靠”背模板”得分。

难度过滤与人工审核:全部题目经过难度过滤、多样性扩充、模型扩题与人工审核,形成 1460 道高质量题目。

混合评分框架:数值题用 math-verify 工具解析验证;选择题和文本题使用 GPT-4.1 进行模型评分。

General365的核心优势

聚焦真实推理能力:区别于 AIME、IMO 等学科竞赛评测,General365 专注日常通用逻辑,暴露大模型”高分低能”的短板。

高区分度:SOTA 模型也仅勉强及格,避免现有基准(如 BBH、BBEH)性能饱和、无法区分模型的问题。

经得起检验的多样性:语义分布均匀分散,逻辑独立性远高于 BBH 和 BBEH。

开源可复现:GitHub 仓库提供完整评测代码,支持社区快速接入和复现。

General365的项目地址

- 项目官网:https://general365.github.io/

- GitHub仓库:https://github.com/meituan-longcat/General365

- HuggingFace模型库:https://huggingface.co/datasets/meituan-longcat/General365_Public

- arXiv技术论文:https://arxiv.org/pdf/2604.11778

General365的同类竞品对比

| 维度 | General365 | BBH (Big-Bench Hard) | BBEH (Big-Bench Extra Hard) |

|---|---|---|---|

| 评测重点 | 通用推理(K-12 知识) | 综合任务推理 | 高难度综合任务 |

| 题目数量 | 365 种子 + 1095 变体 | 23 项任务 | 多项任务扩展 |

| 多样性 | 极高(语义分布均匀,逻辑独立性强) | 较低(存在明显聚集现象) | 较低(模板化严重) |

| 难度区分度 | 高(SOTA 仅 62.8%) | 低(性能已饱和) | 中等 |

| 评分方式 | 混合评分(规则+模型,准确率 99.6%) | 规则评分为主 | 规则评分为主 |

| 数据公开策略 | 半公开(180 题公开 + 隐藏测试集) | 全公开 | 全公开 |

General365的应用场景

大模型研发评测:帮助模型开发者识别推理能力短板,针对性优化复杂约束、语义干扰、最优策略等薄弱维度。

模型选型参考:为企业用户选择推理能力更强的商用或开源模型提供客观数据支撑。

学术研究:为通用推理领域提供标准化评测工具,推动 LLM 从”学科专家”向”通用推理者”进化。

推理效率分析:支持分析模型准确率与输出 token 数的关系,评估推理效率。